0

| 本文作者: AI研习社 | 2020-04-03 10:41 |

DeepCap:基于弱监督的单目人体动作捕捉

使用嵌入正则化和软相似度度量的方法对文本分类问题进行处理

频域图注意力网络

CVPR 2020 | 基于多视角自然图片的弱监督3D人体姿态估计

基于参数无关风格投影的任意风格迁移

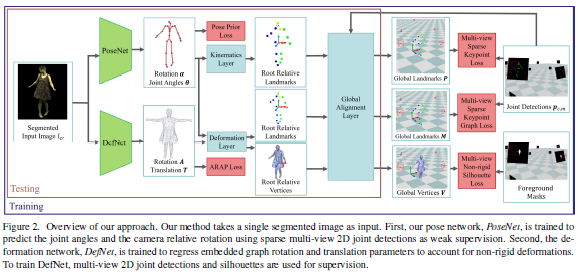

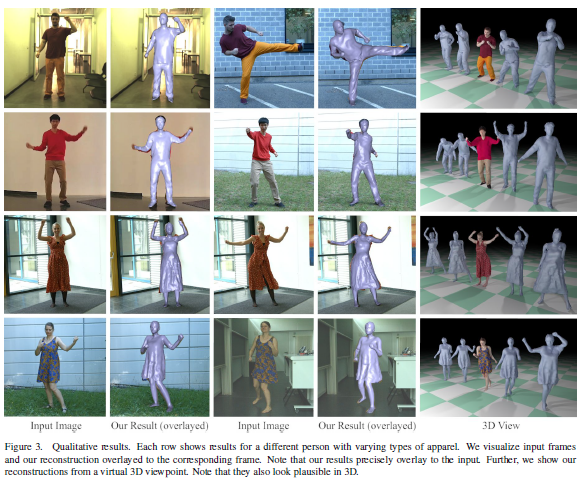

论文名称:DeepCap: Monocular Human Performance Capture Using Weak Supervision

作者: Habermann Marc /Xu Weipeng /Zollhoefer Michael /Pons-Moll Gerard /Theobalt Christian

发表时间:2020/3/18

论文链接:https://paper.yanxishe.com/review/14544?from=leiphonecolumn_paperreview0403

推荐原因

人体动作捕捉是一个非常重要的计算机视觉问题,在电影制作和虚拟/增强现实中有许多应用。

以前的方法要么需要非常昂贵的多视角装置或者无法恢复帧与帧之间的密集几何一致性。本文提出了一种基于深度学习的单目密集人体动作捕捉方法,在训练阶段基于多视角图像以弱监督的方式进行训练,网络架构基于两个独立的网络,以整个任务解耦成姿态估计和表面非刚性形变两个任务。作者通过定性和定量的比较验证了文章方法在质量和鲁棒性方面都要优于目前最优方法。

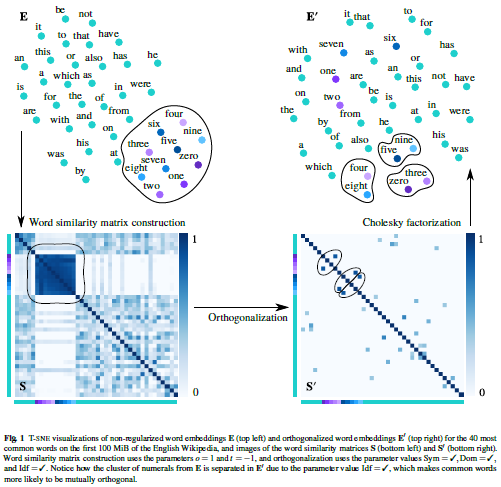

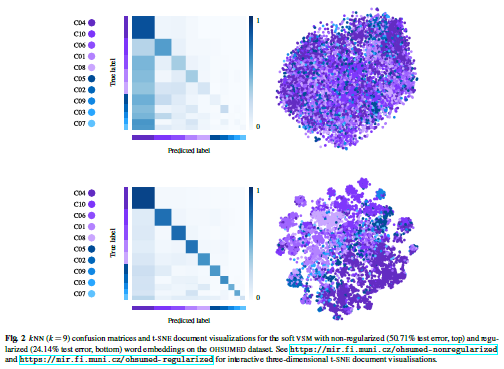

论文名称:Text classification with word embedding regularization and soft similarity measure

作者: Vít Novotný Eniafe Festus Ayetiran Michal Štefánik Petr Sojka

发表时间:2020/3/10

论文链接:https://paper.yanxishe.com/review/14543?from=leiphonecolumn_paperreview0403

推荐原因

作者从词嵌入的生成、机器学习正则化方法、深度学习正则化方法、针对词嵌入的正则化方法等角度详细地介绍了对词嵌入进行正则化的方法和现状,同时提出了对现有的正则化方法的优化,并且使用多种文本相似度度量方法在多个文本分类数据集上进行验证

作者提出了一种基于正交化方法的词嵌入正则化方法,并且证明了这种方法对于多个文本分类任务均能有效减少训练时间和内存消耗,并且分类能力还可得到一定的提升。同时,作者验证了使用正交化的词嵌入时,使用SCM作为文本相似度度量比当前最优的WMD要快的多

个人看法,这篇文章对于基于预训练的模型进行调优或是迁移学习,有参考意义。

论文名称:Spectral Graph Attention Network

作者: Heng Chang /Yu Rong /Tingyang Xu /Wenbing Huang /Somayeh Sojoudi /Junzhou Huang /Wenwu Zhu

发表时间:2020/3/16

论文链接:https://paper.yanxishe.com/review/14497?from=leiphonecolumn_paperreview0403

推荐原因

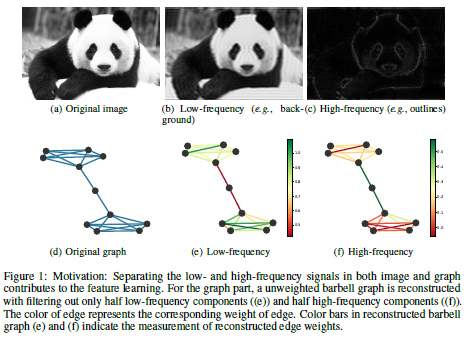

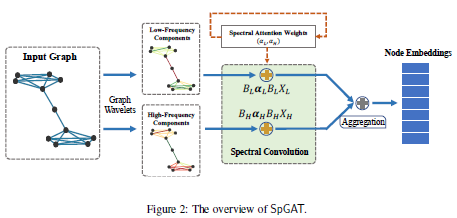

1 核心问题

用于表示学习的图神经网络实在多个领域上有着丰厚的成果,其中,图注意力网络使用了自注意力机制,使用时域学习到了每条边的注意力权重。然而,此机制只注意到了图的局部信息,极大地增加了参数数目。本文主要则面对的是在频域引入图注意力机制的核心问题。

2 创新点

本文提出的频域图注意力网络,主要学习了有关加权过滤器和图小波基的不同频率分量的表示,并基于全局视角对图结构信息进行了显式编码。具体来说,本文选择了图小波作为基,并将其分解为低频分量和高频分量,然后,根据低频分量和高频分量构造两个不同的卷积核,并将注意力机制运用到这两个卷积核上,使其得以捕捉其重要性。最后,本文应用了池化和激活函数去产生最终输出。

3 研究意义

本文提出的方法,比起传统的图注意网络,可以使用更少的学习参数,更好的捕捉图的全局特征,从而实现了高效性。通过在半监督节点分类任务对本论文提出方法的评估,证明了此机制的高效性。

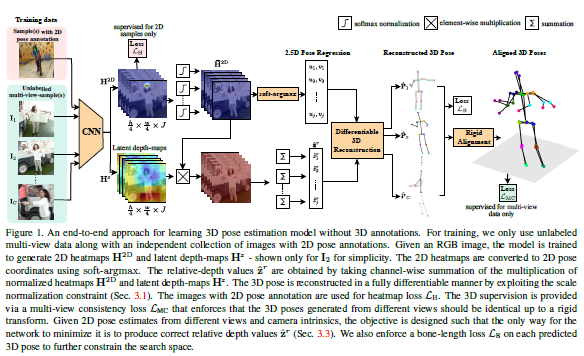

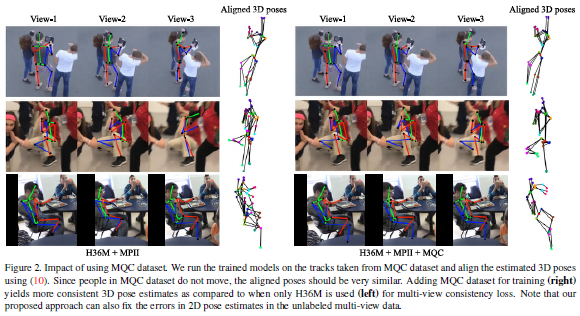

论文名称:Weakly-Supervised 3D Human Pose Learning via Multi-view Images in the Wild

作者: Umar Iqbal /Pavlo Molchanov /Jan Kautz

发表时间:2020/3/17

论文链接:https://paper.yanxishe.com/review/14471?from=leiphonecolumn_paperreview0403

推荐原因

本文已被CVPR2020接收。从自然图片进行3D人体姿态估计是近些年比较火热的研究课题,但缺乏相应的3D标注是目前面临的主要难题。本文提出了一种不需要3D标注的弱监督方案来解决这一问题,从比较容易获得的无标签的多视角数据预测人体的3D姿态。

作者提出了一种新颖的端到端框架,可以使用多视角图片的一致性来实现弱监督训练,作者使用基于2.5D的姿态表示,并提出了一种新颖的目标函数,只有在模型预测的所有视角的姿态合理且一致时才将其最小化。作者最后在两个大型数据集(Human3.6M和MPII-INF-3DHP)上评估了文章方法,在所有半监督/弱监督方法中,文章方法取得了最优异的表现。

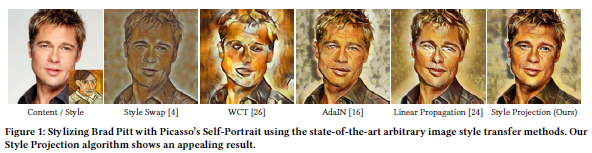

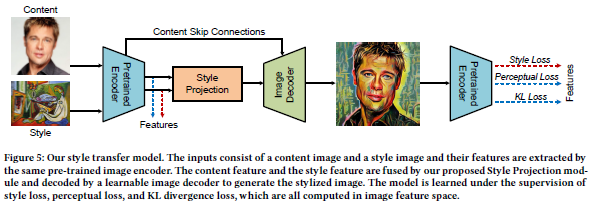

论文名称:Parameter-Free Style Projection for Arbitrary Style Transfer

作者: Siyu Huang /Haoyi Xiong /Tianyang Wang /Qingzhong Wang /Zeyu Chen /Jun Huan /Dejing Dou

发表时间:2020/3/17

论文链接:https://paper.yanxishe.com/review/14461?from=leiphonecolumn_paperreview0403

推荐原因

图像风格迁移是近些年比较热门的研究方向,但任意图像的风格迁移仍然是一个具有挑战性的任务,基于任意一张风格图像来风格化内容图像是一个比较困难的问题。

本文提出了一种参数无关的算法Style Projection,来进行快速有效的内容-风格转换。借助提出的Style Projection模块,作者进一步提出了一个用于任意风格迁移的实时前馈模型。作者通过定性分析、定量分析和用户调研验证了文章方法的有效性和高效性。

雷锋网雷锋网雷锋网

相关文章:

今日 Paper | 协作蒸馏;人脸反欺骗;人脸表示;3D-CariGAN等

雷峰网原创文章,未经授权禁止转载。详情见转载须知。